AI生成的代码安全吗?媒体

人工智能与软件开发中的安全风险

关键要点

人工智能AI在日常操作中越来越普遍,其自动化任务的能力提高了效率和创新标准。尽管AI为各个行业带来了前所未有的生产力提升,但它生成的代码安全性构成了一个重要的脆弱性。AI在简单任务与复杂软件开发中的表现截然不同,复杂的开发需要深刻的逻辑理解和创造力。AI生成的代码在提升开发速度的同时,也引入了独特的安全隐患。企业需要采取措施来平衡创新和安全,尤其是在AI日益融入软件开发的背景下。随着人工智能AI逐渐融入日常运营,它的自动化能力,从简单任务到复杂任务,都在重新定义效率与创新的新标准。我们正看到一个AI驱动的算法世界,它们优化物流、预测趋势,甚至撰写代码,从而在多个行业中实现前所未有的生产力提升。

然而,在这一承诺进步的表面下,潜藏着一个严峻的脆弱性:AI生成代码的安全性。这一悖论表明,推动我们向前发展的技术,同时也可能将我们暴露在新的风险之中。这为对AI双刃剑的细致探索奠定了基础。

尽管AI的众多奇迹不容忽视,其迅速普及引发了一个紧迫的问题:我们该如何利用这项新技术的力量,同时保护我们日益扩大的攻击面?对于代码开发而言,这一问题尤为重要,因为代码是我们数字基础设施的基础。

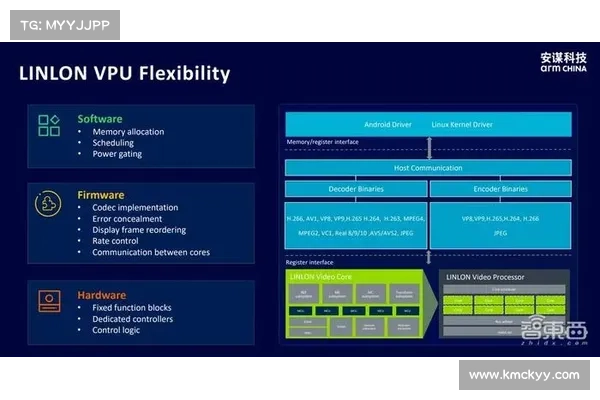

在使用AI进行简单任务与在软件开发这些复杂领域的应用之间,存在显著的对比。AI在自动化常规且规则明确的任务方面表现出色。然而,软件开发的复杂性意味着它需要深刻的逻辑理解、背景知识和创造力,而这些领域中的AI能力依然在不断演进。

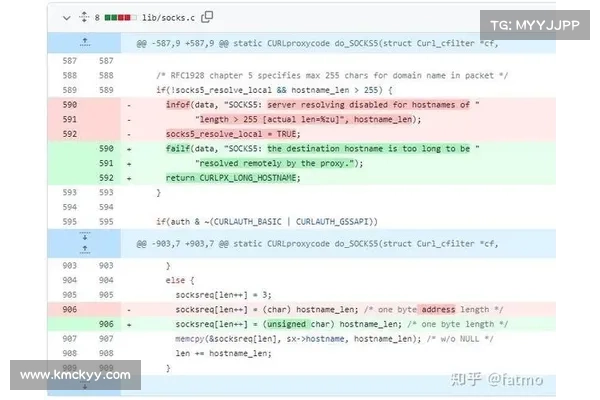

最近的研究指出,尽管AI生成的代码确实能显著加快开发流程,但同时也带来了独特的脆弱性。根据《2023 Snyk AI生成代码安全报告》,AI在编码方面的效率高,但由于人类监督的减少和对复杂安全需求理解的有限,安全脆弱性显著增加。

的确,大型语言模型LLMs的进步显著提升了AI理解和生成代码的能力,充分利用了其处理语言信息的优势。然而,即使如此,与安全脆弱性相关的挑战依然存在。LLMs虽然可以生成语法正确的代码,但可能无法完整理解不同应用的细微安全背景或具体的安全编码实践。《2023麦肯锡报告》也指出,在更复杂的编码任务中,AI的贡献有限。

AI带来的安全风险演变

从熟练黑客利用AI系统弱点,到快速产生的AI生成代码管理挑战,以及未授权AI工具使用的风险,组织需要做好准备。每一个问题都带来了不同的挑战,团队需逐一应对:

挑战描述黑客利用AI脆弱性随着AI系统愈加复杂化,黑客利用系统中的弱点。攻击形式包括提示注入、间接提示注入和训练数据中毒。管理AI生成代码的挑战AI生成代码的自动化特性可能造成安全漏洞,尤其是当代码未被彻底审查和测试时。斯坦福大学的研究发现,AI辅助的代码开发可能导致更多错误。未授权AI工具使用的盲点员工在缺乏监督的情况下使用AI工具,可能会无意中引入风险。根据高德纳的研究,到2027年,75的员工将在IT视野之外获取、修改或创建技术。在创新与安全之间取得平衡

AI生成的代码安全吗?并不安全,但随着AI逐渐成为软件开发生态的一部分,组织必须接受这一现实并适应。他们需要努力确保AI增强的软件在适当的监督下安全。这需要一种以安全为首的思维方式,并主动应对AI生成代码内在的复杂性与风险。生成更多、更快

轻蜂加速器